Абсолютная и относительная погрешности (ошибки).

Пусть некоторая

величина x

измерена n

раз. В результате получен ряд значений

этой величины: x1,

x2,

x3,

…, xn

Величиной, наиболее

близкой к действительному значению,

является среднее арифметическое этих

результатов:

Отсюда следует,

что каждое физическое измерение должно

быть повторено несколько раз.

Разность между

средним значением

измеряемой

величины и значением отдельного измерения

называется абсолютной

погрешностью отдельного измерения:

(13)

Абсолютная

погрешность может быть как положительной,

так и отрицательной и измеряется в тех

же единицах, что и измеряемая величина.

Средняя абсолютная

ошибка результата — это среднее

арифметическое значений абсолютных

погрешностей отдельных измерений,

взятых по абсолютной величине (модулю):

(14)

Отношения

называются относительными погрешностями

(ошибками) отдельных измерений.

Отношение средней

абсолютной погрешности результата

к среднему арифметическому значению

измеряемой величины называют относительной

ошибкой результата и выражают в процентах:

Относительная

ошибка характеризует точность измерения.

Законы распределения случайных величин.

Результат измерения

физической величины зависит от многих

факторов, влияние которых заранее учесть

невозможно. Поэтому значения, полученные

в результате прямых измерений какого

— либо параметра, являются случайными,

обычно не совпадающие между собой.

Следовательно, случайные

величины —

это такие величины, которые в зависимости

от обстоятельств могут принимать те

или иные значения. Если случайная

величина принимает только определенные

числовые значения, то она называется

дискретной.

Например,

количество заболеваний в данном регионе

за год, оценка, полученная студентом на

экзамене, энергия электрона в атоме и

т.д.

Непрерывная

случайная величина принимает любые

значения в данном интервале.

Например: температура

тела человека, мгновенные скорости

теплового движения молекул, содержание

кислорода в воздухе и т.д.

Под событием

понимается всякий результат или исход

испытания. В теории вероятностей

рассматриваются события, которые при

выполнение некоторых условий могут

произойти, а могут не произойти. Такие

события называются

случайными.

Например, событие, состоящее в появлении

цифры 1 при выполнении условия — бросания

игральной кости, может произойти, а

может не произойти.

Если событие

неизбежно происходит в результате

каждого испытания, то оно называется

достоверным.

Событие называется невозможным,

если оно вообще не происходит ни при

каких условиях.

Два события,

одновременное появление которых

невозможно, называются несовместными.

Пусть случайное

событие А в серии из n

независимых испытаний произошло m

раз, тогда отношение:

называется

относительной частотой события А. Для

каждой относительной частоты выполняется

неравенство:

При небольшом

числе опытов относительная частота

событий в значительной мере имеет

случайный характер и может заметно

изменяться от одной группы опытов к

другой. Однако при увеличении числа

опытов частота событий все более теряет

свой случайный характер и приближается

к некоторому постоянному положительному

числу, которое является количественной

мерой возможности реализации случайного

события А. Предел, к которому стремится

относительная частота событий при

неограниченном увеличении числа

испытаний, называется статистической

вероятностью события:

Например, при

многократном бросании монеты частота

выпадения герба будет лишь незначительно

отличаться от ½. Для достоверного события

вероятность Р(А) равна единице. Если

Р=0, то событие невозможно.

Математическим

ожиданием

дискретной случайной величины называется

сумма произведений всех ее возможных

значений хi

на вероятность этих значений рi:

Статистическим

аналогом математического ожидания

является среднее арифметическое значений

:

,

где mi

— число дискретных случайных величин,

имеющих значение хi.

Для непрерывной

случайной величины математическим

ожиданием служит интеграл:

,

где р(х) — плотность

вероятности.

Отдельные значения

случайной величины группируются около

математического ожидания. Отклонение

случайной величины от ее математического

ожидания (среднего значения) характеризуется

дисперсией,

которая для дискретной случайной

величины определяется формулой:

(15)

(16)

Дисперсия имеет

размерность случайной величины. Для

того, чтобы оценивать рассеяние

(отклонение) случайной величины в

единицах той же размерности, введено

понятие среднего

квадратичного отклонения

σ(Х), которое

равно корню квадратному из дисперсии:

(17)

Вместо среднего

квадратичного отклонения иногда

используется термин «стандартное

отклонение».

Всякое отношение,

устанавливающее связь между всеми

возможными значениями случайной величины

и соответствующими им вероятностями,

называется законом

распределения случайной величины.

Формы задания закона распределения

могут быть разными:

а) ряд распределения

(для дискретных величин);

б) функция

распределения;

в) кривая распределения

(для непрерывных величин).

Существует

относительно много законов распределения

случайных величин.

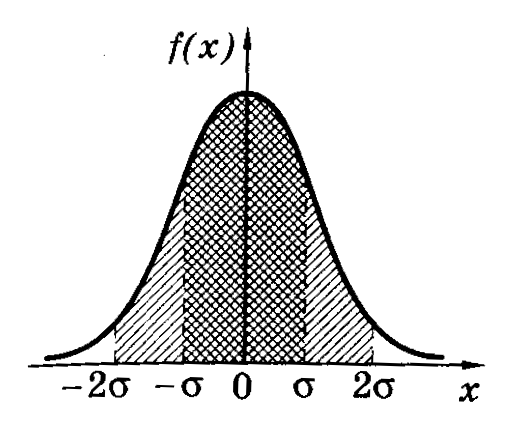

Нормальный

закон распределения случайных

величин (закон

Гаусса).

Случайная величина

распределена по

нормальному закону, если ее плотность

вероятности f(x)

определяется формулой:

(18),

где <x>

— математическое ожидание (среднее

значение) случайной величины <x>

= M

(X);

—

среднее квадратичное отклонение;

—

основание натурального логарифма

(неперово число);

f

(x)

– плотность вероятности (функция

распределения вероятностей).

Многие случайные

величины (в том числе все случайные

погрешности) подчиняются нормальному

закону распределения (закону Гаусса).

Для этого распределения наиболее

вероятным значением

измеряемой

величины

является

её среднее

арифметическое

значение.

График нормального

закона распределения изображен на

рисунке (колоколообразная кривая).

Кривая симметрична

относительно прямой х=<x>=α,

следовательно, отклонения случайной

величины вправо и влево от <x>=α

равновероятны. При х=<x>±

кривая асимптотически приближается к

оси абсцисс. Если х=<x>,

то функция распределения вероятностей

f(x)

максимальна и принимает вид:

(19)

Таким образом,

максимальное значение функции fmax(x)

зависит от величины среднего квадратичного

отклонения. На рисунке изображены 3

кривые распределения. Для кривых 1 и 2

<x>

= α = 0 соответствующие значения среднего

квадратичного отклонения различны, при

этом 2>1.

(При увеличении

кривая распределения становится более

пологой, а при уменьшении

– вытягивается вверх). Для кривой 3 <x>

= α ≠ 0 и 3

= 2.

Закон

распределения

молекул в газах по скоростям называется

распределением

Максвелла.

Функция плотности вероятности попадания

скоростей молекул в определенный

интервал

теоретически была определена в 1860 году

английским физиком Максвеллом

. На рисунке

распределение Максвелла представлено

графически. Распределение движется

вправо или влево в зависимости от

температуры газа (на рисунке Т1

< Т2).

Закон распределения Максвелла определяется

формулой:

(20),

где mо

– масса молекулы, k

– постоянная Больцмана, Т – абсолютная

температура газа,

—

скорость молекулы.

Распределение

концентрации молекул газа в атмосфере

Земли (т.е.

в силовом поле) в зависимости от высоты

было дано австрийским физиком Больцманом

и называется

распределением

Больцмана:

(21)

Где n(h)

– концентрация молекул газа на высоте

h,

n0

– концентрация у поверхности Земли, g

– ускорение свободного падения, m

– масса молекулы.

Распределение

Больцмана.

Совокупность всех

значений случайной величины называется

простым

статистическим рядом.

Так как простой статистический ряд

оказывается большим, то его преобразуют

в вариационный

статистический

ряд или интервальный

статистический ряд. По интервальному

статистическому ряду для оценки вида

функции распределения вероятностей по

экспериментальным данным строят

гистограмму

– столбчатую

диаграмму. (Гистограмма – от греческих

слов “histos”–

столб и “gramma”–

запись).

n

-

h

Гистограмма

распределения Больцмана.

Для построения

гистограммы интервал, содержащий

полученные значения случайной величины

делят на несколько интервалов xi

одинаковой ширины. Для каждого интервала

подсчитывают число mi

значений случайной величины, попавших

в этот интервал. После этого вычисляют

плотность частоты случайной величины

для каждого интервала xi

и среднее значение случайной величины

<xi

> в каждом интервале.

Затем по оси абсцисс

откладывают интервалы xi,

являющиеся основаниями прямоугольников,

высота которых равна

(или

высотой

– плотностью относительной частоты

).

Расчетами показано,

что вероятность попадания нормально

распределенной случайной величины в

интервале значений от <x>–

до <x>+

в среднем равна 68%. В границах вдвое

более широких (<x>–2;

<x>+2)

размещается в среднем 95% всех значений

измерений, а в интервале (<x>–3;<x>+3)

– уже 99,7%. Таким образом, вероятность

того, что отклонение значений нормально

распределенной случайной величины

превысит 3

(

– среднее квадратичное отклонение)

чрезвычайно мала (~0,003). Такое событие

можно считать практически невозможным.

Поэтому границы <x>–3

и <x>+3

принимаются за границы практически

возможных значений нормально распределенной

случайной величины («правило трех

сигм»).

Если число измерений

(объем выборки) невелико (n<30),

дисперсия вычисляется по формуле:

(22)

Уточненное среднее

квадратичное отклонение отдельного

измерения вычисляется по формуле:

(23)

Напомним, что для

эмпирического распределения по выборке

аналогом математического ожидания

является среднее арифметическое значение

<x>

измеряемой величины.

Чтобы дать

представление о точности и надежности

оценки измеряемой величины, используют

понятия доверительного интервала и

доверительной вероятности.

Доверительным

интервалом

называется интервал (<x>–x,

<x>+x),

в который по определению попадает с

заданной вероятностью действительное

(истинное) значение измеряемой величины.

Доверительный интервал характеризует

точность полученного результата: чем

уже доверительный интервал, тем меньше

погрешность.

Доверительной

вероятностью

(надежностью)

результата серии измерений называется

вероятность того, что истинное значение

измеряемой величины попадает в данный

доверительный интервал (<x>±x).

Чем больше величина доверительного

интервала, т.е. чем больше x,

тем с большей надежностью величина <x>

попадает в этот интервал. Надежность

выбирается самим исследователем

самостоятельно, например, =0,95;

0,98. В медицинских и биологических

исследованиях, как правило, доверительную

вероятность (надежность) принимают

равной 0,95.

Если величина х

подчиняется нормальному закону

распределения Гаусса, а <x>

и <>

оцениваются по выборке (числу измерений)

и если объем выборки невелик (n<30),

то интервал (<x>

– t,n<>,

<x>

+ t,n<>)

будет доверительным интервалом для

известного параметра х с доверительной

вероятностью .

Коэффициент t,n

называется коэффициентом

Стьюдента

(этот коэффициент был предложен в 1908 г.

английским математиком и химиком В.С.

Госсетом, публиковавшим свои работы

под псевдонимом «Стьюдент» – студент).

Значении коэффициента

Стьюдента t,n

зависит от доверительной вероятности

и числа измерений n

(объема выборки). Некоторые значения

коэффициента Стьюдента приведены в

таблице 1.

Таблица 1

|

n |

|

||||||

|

0,6 |

0,7 |

0,8 |

0,9 |

0,95 |

0,98 |

0,99 |

|

|

2 |

1,38 |

2,0 |

3,1 |

6,3 |

12,7 |

31,8 |

63,7 |

|

3 |

1,06 |

1,3 |

1,9 |

2,9 |

4,3 |

7,0 |

9,9 |

|

4 |

0,98 |

1,3 |

1,6 |

2,4 |

3,2 |

4,5 |

5,8 |

|

5 |

0,94 |

1,2 |

1,5 |

2,1 |

2,8 |

3,7 |

4,6 |

|

6 |

0,92 |

1,2 |

1,5 |

2,0 |

2,6 |

3,4 |

4,0 |

|

7 |

0,90 |

1,1 |

1,4 |

1,9 |

2,4 |

3,1 |

3,7 |

|

8 |

0,90 |

1,1 |

1,4 |

1,9 |

2,4 |

3,0 |

3,5 |

|

9 |

0,90 |

1,1 |

1,4 |

1,9 |

2,3 |

2,9 |

3,4 |

|

10 |

0,88 |

1,1 |

1,4 |

1,9 |

2,3 |

2,8 |

3,3 |

В таблице 1 в верхней

строке заданы значения доверительной

вероятности

от 0,6 до 0,99, в левом столбце – значение

n.

Коэффициент Стьюдента следует искать

на пересечении соответствующих строки

и столбца.

Окончательный

результат измерений записывается в

виде:

(25)

Где

– полуширина доверительного интервала.

Результат серии

измерений оценивается относительной

погрешностью:

(26)

Для того чтобы модель линейной регрессии можно было применять на практике необходимо сначала оценить её качество. Для этих целей предложен ряд показателей, каждый из которых предназначен для использования в различных ситуациях и имеет свои особенности применения (линейные и нелинейные, устойчивые к аномалиям, абсолютные и относительные, и т.д.). Корректный выбор меры для оценки качества модели является одним из важных факторов успеха в решении задач анализа данных.

«Хорошая» аналитическая модель должна удовлетворять двум, зачастую противоречивым, требованиям — как можно лучше соответствовать данным и при этом быть удобной для интерпретации пользователем. Действительно, повышение соответствия модели данным как правило связано с её усложнением (в случае регрессии — увеличением числа входных переменных модели). А чем сложнее модель, тем ниже её интерпретируемость.

Поэтому при выборе между простой и сложной моделью последняя должна значимо увеличивать соответствие модели данным чтобы оправдать рост сложности и соответствующее снижение интерпретируемости. Если это условие не выполняется, то следует выбрать более простую модель.

Таким образом, чтобы оценить, насколько повышение сложности модели значимо увеличивает её точность, необходимо использовать аппарат оценки качества регрессионных моделей. Он включает в себя следующие меры:

- Среднеквадратичная ошибка (MSE).

- Корень из среднеквадратичной ошибки (RMSE).

- Среднеквадратичная ошибка в процентах (MSPE).

- Средняя абсолютная ошибка (MAE).

- Средняя абсолютная ошибка в процентах (MAPE).

- Cимметричная средняя абсолютная процентная ошибка (SMAPE).

- Средняя абсолютная масштабированная ошибка (MASE)

- Средняя относительная ошибка (MRE).

- Среднеквадратичная логарифмическая ошибка (RMSLE).

- Коэффициент детерминации R-квадрат.

- Скорректированный коэффициент детеминации.

Прежде чем перейти к изучению метрик качества, введём некоторые базовые понятия, которые нам в этом помогут. Для этого рассмотрим рисунок.

Рисунок 1. Линейная регрессия

Наклонная прямая представляет собой линию регрессии с переменной, на которой расположены точки, соответствующие предсказанным значениям выходной переменной widehat{y} (кружки синего цвета). Оранжевые кружки представляют фактические (наблюдаемые) значения y . Расстояния между ними и линией регрессии — это ошибка предсказания модели y-widehat{y} (невязка, остатки). Именно с её использованием вычисляются все приведённые в статье меры качества.

Горизонтальная линия представляет собой модель простого среднего, где коэффициент при независимой переменной x равен нулю, и остаётся только свободный член b, который становится равным среднему арифметическому фактических значений выходной переменной, т.е. b=overline{y}. Очевидно, что такая модель для любого значения входной переменной будет выдавать одно и то же значение выходной — overline{y}.

В линейной регрессии такая модель рассматривается как «бесполезная», хуже которой работает только «случайный угадыватель». Однако, она используется для оценки, насколько дисперсия фактических значений y относительно линии среднего, больше, чем относительно линии регрессии с переменной, т.е. насколько модель с переменной лучше «бесполезной».

MSE

Среднеквадратичная ошибка (Mean Squared Error) применяется в случаях, когда требуется подчеркнуть большие ошибки и выбрать модель, которая дает меньше именно больших ошибок. Большие значения ошибок становятся заметнее за счет квадратичной зависимости.

Действительно, допустим модель допустила на двух примерах ошибки 5 и 10. В абсолютном выражении они отличаются в два раза, но если их возвести в квадрат, получив 25 и 100 соответственно, то отличие будет уже в четыре раза. Таким образом модель, которая обеспечивает меньшее значение MSE допускает меньше именно больших ошибок.

MSE рассчитывается по формуле:

MSE=frac{1}{n}sumlimits_{i=1}^{n}(y_{i}-widehat{y}_{i})^{2},

где n — количество наблюдений по которым строится модель и количество прогнозов, y_{i} — фактические значение зависимой переменной для i-го наблюдения, widehat{y}_{i} — значение зависимой переменной, предсказанное моделью.

Таким образом, можно сделать вывод, что MSE настроена на отражение влияния именно больших ошибок на качество модели.

Недостатком использования MSE является то, что если на одном или нескольких неудачных примерах, возможно, содержащих аномальные значения будет допущена значительная ошибка, то возведение в квадрат приведёт к ложному выводу, что вся модель работает плохо. С другой стороны, если модель даст небольшие ошибки на большом числе примеров, то может возникнуть обратный эффект — недооценка слабости модели.

RMSE

Корень из среднеквадратичной ошибки (Root Mean Squared Error) вычисляется просто как квадратный корень из MSE:

RMSE=sqrt{frac{1}{n}sumlimits_{i=1}^{n}(y_{i}-widehat{y_{i}})^{2}}

MSE и RMSE могут минимизироваться с помощью одного и того же функционала, поскольку квадратный корень является неубывающей функцией. Например, если у нас есть два набора результатов работы модели, A и B, и MSE для A больше, чем MSE для B, то мы можем быть уверены, что RMSE для A больше RMSE для B. Справедливо и обратное: если MSE(A)<MSE(B), то и RMSE(A)<RMSE(B).

Следовательно, сравнение моделей с помощью RMSE даст такой же результат, что и для MSE. Однако с MSE работать несколько проще, поэтому она более популярна у аналитиков. Кроме этого, имеется небольшая разница между этими двумя ошибками при оптимизации с использованием градиента:

frac{partial RMSE}{partial widehat{y}_{i}}=frac{1}{2sqrt{MSE}}frac{partial MSE}{partial widehat{y}_{i}}

Это означает, что перемещение по градиенту MSE эквивалентно перемещению по градиенту RMSE, но с другой скоростью, и скорость зависит от самой оценки MSE. Таким образом, хотя RMSE и MSE близки с точки зрения оценки моделей, они не являются взаимозаменяемыми при использовании градиента для оптимизации.

Влияние каждой ошибки на RMSE пропорционально величине квадрата ошибки. Поэтому большие ошибки оказывают непропорционально большое влияние на RMSE. Следовательно, RMSE можно считать чувствительной к аномальным значениям.

MSPE

Среднеквадратичная ошибка в процентах (Mean Squared Percentage Error) представляет собой относительную ошибку, где разность между наблюдаемым и фактическим значениями делится на наблюдаемое значение и выражается в процентах:

MSPE=frac{100}{n}sumlimits_{i=1}^{n}left ( frac{y_{i}-widehat{y}_{i}}{y_{i}} right )^{2}

Проблемой при использовании MSPE является то, что, если наблюдаемое значение выходной переменной равно 0, значение ошибки становится неопределённым.

MSPE можно рассматривать как взвешенную версию MSE, где вес обратно пропорционален квадрату наблюдаемого значения. Таким образом, при возрастании наблюдаемых значений ошибка имеет тенденцию уменьшаться.

MAE

Cредняя абсолютная ошибка (Mean Absolute Error) вычисляется следующим образом:

MAE=frac{1}{n}sumlimits_{i=1}^{n}left | y_{i}-widehat{y}_{i} right |

Т.е. MAE рассчитывается как среднее абсолютных разностей между наблюдаемым и предсказанным значениями. В отличие от MSE и RMSE она является линейной оценкой, а это значит, что все ошибки в среднем взвешены одинаково. Например, разница между 0 и 10 будет вдвое больше разницы между 0 и 5. Для MSE и RMSE, как отмечено выше, это не так.

Поэтому MAE широко используется, например, в финансовой сфере, где ошибка в 10 долларов должна интерпретироваться как в два раза худшая, чем ошибка в 5 долларов.

MAPE

Средняя абсолютная процентная ошибка (Mean Absolute Percentage Error) вычисляется следующим образом:

MAPE=frac{100}{n}sumlimits_{i=1}^{n}frac{left | y_{i}-widehat{y_{i}} right |}{left | y_{i} right |}

Эта ошибка не имеет размерности и очень проста в интерпретации. Её можно выражать как в долях, так и в процентах. Если получилось, например, что MAPE=11.4, то это говорит о том, что ошибка составила 11.4% от фактического значения.

SMAPE

Cимметричная средняя абсолютная процентная ошибка (Symmetric Mean Absolute Percentage Error) — это мера точности, основанная на процентных (или относительных) ошибках. Обычно определяется следующим образом:

SMAPE=frac{100}{n}sumlimits_{i=1}^{n}frac{left | y_{i}-widehat{y_{i}} right |}{(left | y_{i} right |+left | widehat{y}_{i} right |)/2}

Т.е. абсолютная разность между наблюдаемым и предсказанным значениями делится на полусумму их модулей. В отличие от обычной MAPE, симметричная имеет ограничение на диапазон значений. В приведённой формуле он составляет от 0 до 200%. Однако, поскольку диапазон от 0 до 100% гораздо удобнее интерпретировать, часто используют формулу, где отсутствует деление знаменателя на 2.

Одной из возможных проблем SMAPE является неполная симметрия, поскольку в разных диапазонах ошибка вычисляется неодинаково. Это иллюстрируется следующим примером: если y_{i}=100 и widehat{y}_{i}=110, то SMAPE=4.76, а если y_{i}=100 и widehat{y}_{i}=90, то SMAPE=5.26.

Ограничение SMAPE заключается в том, что, если наблюдаемое или предсказанное значение равно 0, ошибка резко возрастет до верхнего предела (200% или 100%).

MASE

Средняя абсолютная масштабированная ошибка (Mean absolute scaled error) — это показатель, который позволяет сравнивать две модели. Если поместить MAE для новой модели в числитель, а MAE для исходной модели в знаменатель, то полученное отношение и будет равно MASE. Если значение MASE меньше 1, то новая модель работает лучше, если MASE равно 1, то модели работают одинаково, а если значение MASE больше 1, то исходная модель работает лучше, чем новая модель. Формула для расчета MASE имеет вид:

MASE=frac{MAE_{i}}{MAE_{j}}

MASE симметрична и устойчива к выбросам.

MRE

Средняя относительная ошибка (Mean Relative Error) вычисляется по формуле:

MRE=frac{1}{n}sumlimits_{i=1}^{n}frac{left | y_{i}-widehat{y}_{i}right |}{left | y_{i} right |}

Несложно увидеть, что данная мера показывает величину абсолютной ошибки относительно фактического значения выходной переменной (поэтому иногда эту ошибку называют также средней относительной абсолютной ошибкой, MRAE). Действительно, если значение абсолютной ошибки, скажем, равно 10, то сложно сказать много это или мало. Например, относительно значения выходной переменной, равного 20, это составляет 50%, что достаточно много. Однако относительно значения выходной переменной, равного 100, это будет уже 10%, что является вполне нормальным результатом.

Очевидно, что при вычислении MRE нельзя применять наблюдения, в которых y_{i}=0.

Таким образом, MRE позволяет более адекватно оценить величину ошибки, чем абсолютные ошибки. Кроме этого она является безразмерной величиной, что упрощает интерпретацию.

RMSLE

Среднеквадратичная логарифмическая ошибка (Root Mean Squared Logarithmic Error) представляет собой RMSE, вычисленную в логарифмическом масштабе:

RMSLE=sqrt{frac{1}{n}sumlimits_{i=1}^{n}(log(widehat{y}_{i}+1)-log{(y_{i}+1}))^{2}}

Константы, равные 1, добавляемые в скобках, необходимы чтобы не допустить обращения в 0 выражения под логарифмом, поскольку логарифм нуля не существует.

Известно, что логарифмирование приводит к сжатию исходного диапазона изменения значений переменной. Поэтому применение RMSLE целесообразно, если предсказанное и фактическое значения выходной переменной различаются на порядок и больше.

R-квадрат

Перечисленные выше ошибки не так просто интерпретировать. Действительно, просто зная значение средней абсолютной ошибки, скажем, равное 10, мы сразу не можем сказать хорошая это ошибка или плохая, и что нужно сделать чтобы улучшить модель.

В этой связи представляет интерес использование для оценки качества регрессионной модели не значения ошибок, а величину показывающую, насколько данная модель работает лучше, чем модель, в которой присутствует только константа, а входные переменные отсутствуют или коэффициенты регрессии при них равны нулю.

Именно такой мерой и является коэффициент детерминации (Coefficient of determination), который показывает долю дисперсии зависимой переменной, объяснённой с помощью регрессионной модели. Наиболее общей формулой для вычисления коэффициента детерминации является следующая:

R^{2}=1-frac{sumlimits_{i=1}^{n}(widehat{y}_{i}-y_{i})^{2}}{sumlimits_{i=1}^{n}({overline{y}}_{i}-y_{i})^{2}}

Практически, в числителе данного выражения стоит среднеквадратическая ошибка оцениваемой модели, а в знаменателе — модели, в которой присутствует только константа.

Главным преимуществом коэффициента детерминации перед мерами, основанными на ошибках, является его инвариантность к масштабу данных. Кроме того, он всегда изменяется в диапазоне от −∞ до 1. При этом значения близкие к 1 указывают на высокую степень соответствия модели данным. Очевидно, что это имеет место, когда отношение в формуле стремится к 0, т.е. ошибка модели с переменными намного меньше ошибки модели с константой. R^{2}=0 показывает, что между независимой и зависимой переменными модели имеет место функциональная зависимость.

Когда значение коэффициента близко к 0 (т.е. ошибка модели с переменными примерно равна ошибке модели только с константой), это указывает на низкое соответствие модели данным, когда модель с переменными работает не лучше модели с константой.

Кроме этого, бывают ситуации, когда коэффициент R^{2} принимает отрицательные значения (обычно небольшие). Это произойдёт, если ошибка модели среднего становится меньше ошибки модели с переменной. В этом случае оказывается, что добавление в модель с константой некоторой переменной только ухудшает её (т.е. регрессионная модель с переменной работает хуже, чем предсказание с помощью простой средней).

На практике используют следующую шкалу оценок. Модель, для которой R^{2}>0.5, является удовлетворительной. Если R^{2}>0.8, то модель рассматривается как очень хорошая. Значения, меньшие 0.5 говорят о том, что модель плохая.

Скорректированный R-квадрат

Основной проблемой при использовании коэффициента детерминации является то, что он увеличивается (или, по крайней мере, не уменьшается) при добавлении в модель новых переменных, даже если эти переменные никак не связаны с зависимой переменной.

В связи с этим возникают две проблемы. Первая заключается в том, что не все переменные, добавляемые в модель, могут значимо увеличивать её точность, но при этом всегда увеличивают её сложность. Вторая проблема — с помощью коэффициента детерминации нельзя сравнивать модели с разным числом переменных. Чтобы преодолеть эти проблемы используют альтернативные показатели, одним из которых является скорректированный коэффициент детерминации (Adjasted coefficient of determinftion).

Скорректированный коэффициент детерминации даёт возможность сравнивать модели с разным числом переменных так, чтобы их число не влияло на статистику R^{2}, и накладывает штраф за дополнительно включённые в модель переменные. Вычисляется по формуле:

R_{adj}^{2}=1-frac{sumlimits_{i=1}^{n}(widehat{y}_{i}-y_{i})^{2}/(n-k)}{sumlimits_{i=1}^{n}({overline{y}}_{i}-y_{i})^{2}/(n-1)}

где n — число наблюдений, на основе которых строится модель, k — количество переменных в модели.

Скорректированный коэффициент детерминации всегда меньше единицы, но теоретически может принимать значения и меньше нуля только при очень малом значении обычного коэффициента детерминации и большом количестве переменных модели.

Сравнение метрик

Резюмируем преимущества и недостатки каждой приведённой метрики в следующей таблице:

| Мера | Сильные стороны | Слабые стороны |

|---|---|---|

| MSE | Позволяет подчеркнуть большие отклонения, простота вычисления. | Имеет тенденцию занижать качество модели, чувствительна к выбросам. Сложность интерпретации из-за квадратичной зависимости. |

| RMSE | Простота интерпретации, поскольку измеряется в тех же единицах, что и целевая переменная. | Имеет тенденцию занижать качество модели, чувствительна к выбросам. |

| MSPE | Нечувствительна к выбросам. Хорошо интерпретируема, поскольку имеет линейный характер. | Поскольку вклад всех ошибок отдельных наблюдений взвешивается одинаково, не позволяет подчёркивать большие и малые ошибки. |

| MAPE | Является безразмерной величиной, поэтому её интерпретация не зависит от предметной области. | Нельзя использовать для наблюдений, в которых значения выходной переменной равны нулю. |

| SMAPE | Позволяет корректно работать с предсказанными значениями независимо от того больше они фактического, или меньше. | Приближение к нулю фактического или предсказанного значения приводит к резкому росту ошибки, поскольку в знаменателе присутствует как фактическое, так и предсказанное значения. |

| MASE | Не зависит от масштаба данных, является симметричной: положительные и отрицательные отклонения от фактического значения учитываются одинаково. Устойчива к выбросам. Позволяет сравнивать модели. | Сложность интерпретации. |

| MRE | Позволяет оценить величину ошибки относительно значения целевой переменной. | Неприменима для наблюдений с нулевым значением выходной переменной. |

| RMSLE | Логарифмирование позволяет сделать величину ошибки более устойчивой, когда разность между фактическим и предсказанным значениями различается на порядок и выше | Может быть затруднена интерпретация из-за нелинейности. |

| R-квадрат | Универсальность, простота интерпретации. | Возрастает даже при включении в модель бесполезных переменных. Плохо работает когда входные переменные зависимы. |

| R-квадрат скорр. | Корректно отражает вклад каждой переменной в модель. | Плохо работает, когда входные переменные зависимы. |

В данной статье рассмотрены наиболее популярные меры качества регрессионных моделей, которые часто используются в различных аналитических приложениях. Эти меры имеют свои особенности применения, знание которых позволит обоснованно выбирать и корректно применять их на практике.

Однако в литературе можно встретить и другие меры качества моделей регрессии, которые предлагаются различными авторами для решения конкретных задач анализа данных.

Другие материалы по теме:

Отбор переменных в моделях линейной регрессии

Репрезентативность выборочных данных

Логистическая регрессия и ROC-анализ — математический аппарат

Перевод

Ссылка на автора

Каждая модель машинного обучения пытается решить проблему с другой целью, используя свой набор данных, и, следовательно, важно понять контекст, прежде чем выбрать метрику. Обычно ответы на следующий вопрос помогают нам выбрать подходящий показатель:

- Тип задачи: регрессия? Классификация?

- Бизнес цель?

- Каково распределение целевой переменной?

Ну, в этом посте я буду обсуждать полезность каждой метрики ошибки в зависимости от цели и проблемы, которую мы пытаемся решить. Часть 1 фокусируется только на показателях оценки регрессии.

Метрики регрессии

- Средняя квадратическая ошибка (MSE)

- Среднеквадратическая ошибка (RMSE)

- Средняя абсолютная ошибка (MAE)

- R в квадрате (R²)

- Скорректированный R квадрат (R²)

- Среднеквадратичная ошибка в процентах (MSPE)

- Средняя абсолютная ошибка в процентах (MAPE)

- Среднеквадратичная логарифмическая ошибка (RMSLE)

Средняя квадратическая ошибка (MSE)

Это, пожалуй, самый простой и распространенный показатель для оценки регрессии, но, вероятно, наименее полезный. Определяется уравнением

гдеyᵢфактический ожидаемый результат иŷᵢэто прогноз модели.

MSE в основном измеряет среднеквадратичную ошибку наших прогнозов. Для каждой точки вычисляется квадратная разница между прогнозами и целью, а затем усредняются эти значения.

Чем выше это значение, тем хуже модель. Он никогда не бывает отрицательным, поскольку мы возводим в квадрат отдельные ошибки прогнозирования, прежде чем их суммировать, но для идеальной модели это будет ноль.

Преимущество:Полезно, если у нас есть неожиданные значения, о которых мы должны заботиться. Очень высокое или низкое значение, на которое мы должны обратить внимание.

Недостаток:Если мы сделаем один очень плохой прогноз, возведение в квадрат сделает ошибку еще хуже, и это может исказить метрику в сторону переоценки плохости модели. Это особенно проблематичное поведение, если у нас есть зашумленные данные (то есть данные, которые по какой-либо причине не совсем надежны) — даже в «идеальной» модели может быть высокий MSE в этой ситуации, поэтому становится трудно судить, насколько хорошо модель выполняет. С другой стороны, если все ошибки малы или, скорее, меньше 1, то ощущается противоположный эффект: мы можем недооценивать недостатки модели.

Обратите внимание, чтоесли мы хотим иметь постоянный прогноз, лучшим будетсреднее значение целевых значений.Его можно найти, установив производную нашей полной ошибки по этой константе в ноль, и найти ее из этого уравнения.

Среднеквадратическая ошибка (RMSE)

RMSE — это просто квадратный корень из MSE. Квадратный корень введен, чтобы масштаб ошибок был таким же, как масштаб целей.

Теперь очень важно понять, в каком смысле RMSE похож на MSE, и в чем разница.

Во-первых, они похожи с точки зрения их минимизаторов, каждый минимизатор MSE также является минимизатором для RMSE и наоборот, поскольку квадратный корень является неубывающей функцией. Например, если у нас есть два набора предсказаний, A и B, и скажем, что MSE для A больше, чем MSE для B, то мы можем быть уверены, что RMSE для A больше RMSE для B. И это также работает в противоположном направлении. ,

Что это значит для нас?

Это означает, что, если целевым показателем является RMSE, мы все равно можем сравнивать наши модели, используя MSE, поскольку MSE упорядочит модели так же, как RMSE. Таким образом, мы можем оптимизировать MSE вместо RMSE.

На самом деле, с MSE работать немного проще, поэтому все используют MSE вместо RMSE. Также есть небольшая разница между этими двумя моделями на основе градиента.

Это означает, что путешествие по градиенту MSE эквивалентно путешествию по градиенту RMSE, но с другой скоростью потока, и скорость потока зависит от самой оценки MSE.

Таким образом, хотя RMSE и MSE действительно схожи с точки зрения оценки моделей, они не могут быть сразу взаимозаменяемыми для методов на основе градиента. Возможно, нам нужно будет настроить некоторые параметры, такие как скорость обучения.

Средняя абсолютная ошибка (MAE)

В MAE ошибка рассчитывается как среднее абсолютных разностей между целевыми значениями и прогнозами. MAE — это линейная оценка, которая означает, чтовсе индивидуальные различия взвешены одинаковов среднем. Например, разница между 10 и 0 будет вдвое больше разницы между 5 и 0. Однако то же самое не верно для RMSE. Математически он рассчитывается по следующей формуле:

Что важно в этой метрике, так это то, что онанаказывает огромные ошибки, которые не так плохо, как MSE.Таким образом, он не так чувствителен к выбросам, как среднеквадратическая ошибка.

MAE широко используется в финансах, где ошибка в 10 долларов обычно в два раза хуже, чем ошибка в 5 долларов. С другой стороны, метрика MSE считает, что ошибка в 10 долларов в четыре раза хуже, чем ошибка в 5 долларов. MAE легче обосновать, чем RMSE.

Еще одна важная вещь в MAE — это его градиенты относительно прогнозов. Gradiend — это пошаговая функция, которая принимает -1, когда Y_hat меньше цели, и +1, когда она больше.

Теперь градиент не определен, когда предсказание является совершенным, потому что, когда Y_hat равен Y, мы не можем оценить градиент. Это не определено.

Таким образом, формально, MAE не дифференцируемо, но на самом деле, как часто ваши прогнозы точно измеряют цель. Даже если они это сделают, мы можем написать простое условие IF и вернуть ноль, если это так, и через градиент в противном случае. Также известно, что вторая производная везде нулевая и не определена в нулевой точке.

Обратите внимание, чтоесли мы хотим иметь постоянный прогноз, лучшим будетсрединное значение целевых значений.Его можно найти, установив производную нашей полной ошибки по этой константе в ноль, и найти ее из этого уравнения.

R в квадрате (R²)

А что если я скажу вам, что MSE для моих моделей предсказаний составляет 32? Должен ли я улучшить свою модель или она достаточно хороша? Или что, если мой MSE был 0,4? На самом деле, трудно понять, хороша наша модель или нет, посмотрев на абсолютные значения MSE или RMSE. Мы, вероятно, захотим измерить, как Во многом наша модель лучше, чем постоянная базовая линия.

Коэффициент детерминации, или R² (иногда читаемый как R-два), является еще одним показателем, который мы можем использовать для оценки модели, и он тесно связан с MSE, но имеет преимущество в том, чтобезмасштабное— не имеет значения, являются ли выходные значения очень большими или очень маленькими,R² всегда будет между -∞ и 1.

Когда R² отрицательно, это означает, что модель хуже, чем предсказание среднего значения.

MSE модели рассчитывается, как указано выше, в то время как MSE базовой линии определяется как:

гдеYс чертой означает среднее из наблюдаемогоyᵢ.

Чтобы сделать это более ясным, этот базовый MSE можно рассматривать как MSE, чтопростейшиймодель получит. Простейшей возможной моделью было бывсегдапредсказать среднее по всем выборкам. Значение, близкое к 1, указывает на модель с ошибкой, близкой к нулю, а значение, близкое к нулю, указывает на модель, очень близкую к базовой линии.

В заключение, R² — это соотношение между тем, насколько хороша наша модель, и тем, насколько хороша модель наивного среднего.

Распространенное заблуждение:Многие статьи в Интернете утверждают, что диапазон R² лежит между 0 и 1, что на самом деле не соответствует действительности. Максимальное значение R² равно 1, но минимальное может быть минус бесконечность.

Например, рассмотрим действительно дрянную модель, предсказывающую крайне отрицательное значение для всех наблюдений, даже если y_actual положительно. В этом случае R² будет меньше 0. Это крайне маловероятный сценарий, но возможность все еще существует.

MAE против MSE

Я заявил, что MAE более устойчив (менее чувствителен к выбросам), чем MSE, но это не значит, что всегда лучше использовать MAE. Следующие вопросы помогут вам решить:

Взять домой сообщение

В этой статье мы обсудили несколько важных метрик регрессии. Сначала мы обсудили среднеквадратичную ошибку и поняли, что наилучшей константой для нее является среднее целевое значение. Среднеквадратичная ошибка и R² очень похожи на MSE с точки зрения оптимизации. Затем мы обсудили среднюю абсолютную ошибку и когда люди предпочитают использовать MAE вместо MSE.

Спасибо за чтение, и я с нетерпением жду, чтобы услышать ваши вопросы

P.SСледите за моей следующей статьей, которая изучает другие более продвинутые метрики регрессии. Если вы хотите больше узнать о мире машинного обучения, вы также можете подписаться на меня в Instagram, напишите мне напрямую или найди меня на linkedin, Я хотел бы услышать от вас.

Ресурсы:

[1] https://dmitryulyanov.github.io/about

In the previous post, we saw the various metrics which are used to assess a machine learning model’s performance. Among those, the confusion matrix is used to evaluate a classification problem’s accuracy. On the other hand, mean squared error (MSE), and mean absolute error (MAE) are used to evaluate the regression problem’s accuracy.

The F1 score is useful when the size of the positive class is relatively small.

ROC Area Under Curve is useful when we are not concerned about whether the small dataset/class of dataset is positive or not, in contrast to the F1 score where the class being positive is important.

In today’s post, we will understand what MAE is and explore more about what it means to vary these metrics. In addition to this, we will discuss a few more metrics that will help us decide if the machine learning model would be useful in real-life scenarios or not.

1. What is Mean Absolute Error or MAE

Mean Absolute Error(MAE) is the mean size of the mistakes in collected predictions. We know that an error basically is the absolute difference between the actual or true values and the values that are predicted. The absolute difference means that if the result has a negative sign, it is ignored.

Hence, MAE = True values – Predicted values

MAE takes the average of this error from every sample in a dataset and gives the output.

This can be implemented using sklearn’s mean_absolute_error method:

from sklearn.metrics import mean_absolute_error

# predicting home prices in some area

predicted_home_prices = mycity_model.predict(X)

mean_absolute_error(y, predicted_home_prices)But this value might not be the relevant aspect that can be considered while dealing with a real-life situation because the data we use to build the model as well as evaluate it is the same, which means the model has no exposure to real, never-seen-before data. So, it may perform extremely well on seen data but might fail miserably when it encounters real, unseen data.

The concepts of underfitting and overfitting can be pondered over, from here:

Underfitting: The scenario when a machine learning model almost exactly matches the training data but performs very poorly when it encounters new data or validation set.

Overfitting: The scenario when a machine learning model is unable to capture the important patterns and insights from the data, which results in the model performing poorly on training data itself.

P.S. In the upcoming posts, we will understand how to fit the model in the right way using many methods like feature normalization, feature generation, and much more.

2. What is Mean Squared Error or MSE

The Mean Absolute Error is the squared mean of the difference between the actual values and predictable values.

How do you Calculate MSE?

Steps to calculate the MSE from a set of X and Y values:

- First, Find the regression line.

- Insert the X values into the linear regression equation to find the new Y values (Y’).

- Subtract the new Y value from the original to get the error.

- Square the values that you go as errors.

- Add up the errors

- Find the mean.

Hence, MSE =

Here N is the total number of observations/rows in the dataset. The sigma symbol denotes the difference between actual and predicted values taken on every i value ranging from 1 to n.

This can be implemented using sklearn‘s mean_squared_error method:

from sklearn.metrics import mean_squared_error

actual_values = [3, -0.5, 2, 7]

predicted_values = [2.5, 0.0, 2, 8]

mean_squared_error(actual_values, predicted_values)In most regression problems, mean squared error is used to determine the model’s performance.

3. What is Root Mean Squared Error or RMSE

RMSE is the standard deviation of the errors which occur when a prediction is made on a dataset. This is the same as MSE (Mean Squared Error) but the root of the value is considered while determining the accuracy of the model.

from sklearn.metrics import mean_squared_error

from math import sqrt

actual_values = [3, -0.5, 2, 7]

predicted_values = [2.5, 0.0, 2, 8]

mean_squared_error(actual_values, predicted_values)

# taking root of mean squared error

root_mean_squared_error = sqrt(mean_squared_error)4. R Squared

It is also known as the coefficient of determination. This metric gives an indication of how good a model fits a given dataset. It indicates how close the regression line (i.e the predicted values plotted) is to the actual data values. The R squared value lies between 0 and 1 where 0 indicates that this model doesn’t fit the given data and 1 indicates that the model fits perfectly to the dataset provided.

import numpy as np

X = np.random.randn(100)

y = np.random.randn(60) # y has nothing to do with X whatsoever

from sklearn.linear_model import LinearRegression

from sklearn.cross_validation import cross_val_score

scores = cross_val_score(LinearRegression(), X, y,scoring='r2')Where to use which Metric to determine the Performance of a Machine Learning Model?

MAE: It is not very sensitive to outliers in comparison to MSE since it doesn’t punish huge errors. It is usually used when the performance is measured on continuous variable data. It gives a linear value, which averages the weighted individual differences equally. The lower the value, the better the model’s performance.

MSE: It is one of the most commonly used metrics, but least useful when a single bad prediction would ruin the entire model’s predicting abilities, i.e when the dataset contains a lot of noise. It is most useful when the dataset contains outliers, or unexpected values (too high or too low values).

RMSE: In RMSE, the errors are squared before they are averaged. This basically implies that RMSE assigns a higher weight to larger errors. This indicates that RMSE is much more useful when large errors are present and they drastically affect the model’s performance. It avoids taking the absolute value of the error and this trait is useful in many mathematical calculations. In this metric also, the lower the value, the better the performance of the model.

Conclusion

Mean Squared Error (MSE), Mean Absolute Error (MAE), Root Mean Squared Error (RMSE), and R-Squared (R2) are all popular metrics for assessing the precision of machine learning algorithms. MSE and MAE report the average difference between predicted and real values, whereas RMSE reports the same information but in the same unit as the objective variable. R2 is the percentage of variance in the objective variable described by the model. These metrics are useful for evaluating model success and comparing various models.

Frequently Asked Questions(FAQs)

1. What is the purpose of Mean Squared Error (MSE) in machine learning?

MSE measures the average difference between predicted and actual values.

2. How do you calculate Root Mean Squared Error (RMSE)?

RMSE is the square root of the average squared difference between predicted and actual values.

3. What is the significance of R-Squared (R²) in machine learning?

R² measures the proportion of variance in the target variable that is explained by the model.

4. How can Mean Absolute Error (MAE) help to evaluate model performance?

MAE measures the average absolute difference between predicted and actual values, providing a more easily interpretable metric for non-normal distributions.

5. How do you calculate MSE?

- First, Find the regression line.

- Insert the X values into the linear regression equation to find the new Y values (Y’).

- Subtract the new Y value from the original to get the error.

- Square the values that you go as errors.

- Add up the errors

- Find the mean.

You may also like:

- How Good is my Machine Learning Model? How do I improve its Performance?

- Machine Learning — How to deal with missing data using Python?

- Machine Learning and Data Visualization using Orange

- Designing a Learning System | The first step to Machine Learning

Абсолютная и относительная погрешности (ошибки).

Пусть некоторая

величина x

измерена n

раз. В результате получен ряд значений

этой величины: x1,

x2,

x3,

…, xn

Величиной, наиболее

близкой к действительному значению,

является среднее арифметическое этих

результатов:

Отсюда следует,

что каждое физическое измерение должно

быть повторено несколько раз.

Разность между

средним значением

измеряемой

величины и значением отдельного измерения

называется абсолютной

погрешностью отдельного измерения:

(13)

Абсолютная

погрешность может быть как положительной,

так и отрицательной и измеряется в тех

же единицах, что и измеряемая величина.

Средняя абсолютная

ошибка результата — это среднее

арифметическое значений абсолютных

погрешностей отдельных измерений,

взятых по абсолютной величине (модулю):

(14)

Отношения

называются относительными погрешностями

(ошибками) отдельных измерений.

Отношение средней

абсолютной погрешности результата

к среднему арифметическому значению

измеряемой величины называют относительной

ошибкой результата и выражают в процентах:

Относительная

ошибка характеризует точность измерения.

Законы распределения случайных величин.

Результат измерения

физической величины зависит от многих

факторов, влияние которых заранее учесть

невозможно. Поэтому значения, полученные

в результате прямых измерений какого

— либо параметра, являются случайными,

обычно не совпадающие между собой.

Следовательно, случайные

величины —

это такие величины, которые в зависимости

от обстоятельств могут принимать те

или иные значения. Если случайная

величина принимает только определенные

числовые значения, то она называется

дискретной.

Например,

количество заболеваний в данном регионе

за год, оценка, полученная студентом на

экзамене, энергия электрона в атоме и

т.д.

Непрерывная

случайная величина принимает любые

значения в данном интервале.

Например: температура

тела человека, мгновенные скорости

теплового движения молекул, содержание

кислорода в воздухе и т.д.

Под событием

понимается всякий результат или исход

испытания. В теории вероятностей

рассматриваются события, которые при

выполнение некоторых условий могут

произойти, а могут не произойти. Такие

события называются

случайными.

Например, событие, состоящее в появлении

цифры 1 при выполнении условия — бросания

игральной кости, может произойти, а

может не произойти.

Если событие

неизбежно происходит в результате

каждого испытания, то оно называется

достоверным.

Событие называется невозможным,

если оно вообще не происходит ни при

каких условиях.

Два события,

одновременное появление которых

невозможно, называются несовместными.

Пусть случайное

событие А в серии из n

независимых испытаний произошло m

раз, тогда отношение:

называется

относительной частотой события А. Для

каждой относительной частоты выполняется

неравенство:

При небольшом

числе опытов относительная частота

событий в значительной мере имеет

случайный характер и может заметно

изменяться от одной группы опытов к

другой. Однако при увеличении числа

опытов частота событий все более теряет

свой случайный характер и приближается

к некоторому постоянному положительному

числу, которое является количественной

мерой возможности реализации случайного

события А. Предел, к которому стремится

относительная частота событий при

неограниченном увеличении числа

испытаний, называется статистической

вероятностью события:

Например, при

многократном бросании монеты частота

выпадения герба будет лишь незначительно

отличаться от ½. Для достоверного события

вероятность Р(А) равна единице. Если

Р=0, то событие невозможно.

Математическим

ожиданием

дискретной случайной величины называется

сумма произведений всех ее возможных

значений хi

на вероятность этих значений рi:

Статистическим

аналогом математического ожидания

является среднее арифметическое значений

:

,

где mi

— число дискретных случайных величин,

имеющих значение хi.

Для непрерывной

случайной величины математическим

ожиданием служит интеграл:

,

где р(х) — плотность

вероятности.

Отдельные значения

случайной величины группируются около

математического ожидания. Отклонение

случайной величины от ее математического

ожидания (среднего значения) характеризуется

дисперсией,

которая для дискретной случайной

величины определяется формулой:

(15)

(16)

Дисперсия имеет

размерность случайной величины. Для

того, чтобы оценивать рассеяние

(отклонение) случайной величины в

единицах той же размерности, введено

понятие среднего

квадратичного отклонения

σ(Х), которое

равно корню квадратному из дисперсии:

(17)

Вместо среднего

квадратичного отклонения иногда

используется термин «стандартное

отклонение».

Всякое отношение,

устанавливающее связь между всеми

возможными значениями случайной величины

и соответствующими им вероятностями,

называется законом

распределения случайной величины.

Формы задания закона распределения

могут быть разными:

а) ряд распределения

(для дискретных величин);

б) функция

распределения;

в) кривая распределения

(для непрерывных величин).

Существует

относительно много законов распределения

случайных величин.

Нормальный

закон распределения случайных

величин (закон

Гаусса).

Случайная величина

распределена по

нормальному закону, если ее плотность

вероятности f(x)

определяется формулой:

(18),

где <x>

— математическое ожидание (среднее

значение) случайной величины <x>

= M

(X);

—

среднее квадратичное отклонение;

—

основание натурального логарифма

(неперово число);

f

(x)

– плотность вероятности (функция

распределения вероятностей).

Многие случайные

величины (в том числе все случайные

погрешности) подчиняются нормальному

закону распределения (закону Гаусса).

Для этого распределения наиболее

вероятным значением

измеряемой

величины

является

её среднее

арифметическое

значение.

График нормального

закона распределения изображен на

рисунке (колоколообразная кривая).

Кривая симметрична

относительно прямой х=<x>=α,

следовательно, отклонения случайной

величины вправо и влево от <x>=α

равновероятны. При х=<x>±

кривая асимптотически приближается к

оси абсцисс. Если х=<x>,

то функция распределения вероятностей

f(x)

максимальна и принимает вид:

(19)

Таким образом,

максимальное значение функции fmax(x)

зависит от величины среднего квадратичного

отклонения. На рисунке изображены 3

кривые распределения. Для кривых 1 и 2

<x>

= α = 0 соответствующие значения среднего

квадратичного отклонения различны, при

этом 2>1.

(При увеличении

кривая распределения становится более

пологой, а при уменьшении

– вытягивается вверх). Для кривой 3 <x>

= α ≠ 0 и 3

= 2.

Закон

распределения

молекул в газах по скоростям называется

распределением

Максвелла.

Функция плотности вероятности попадания

скоростей молекул в определенный

интервал

теоретически была определена в 1860 году

английским физиком Максвеллом

. На рисунке

распределение Максвелла представлено

графически. Распределение движется

вправо или влево в зависимости от

температуры газа (на рисунке Т1

< Т2).

Закон распределения Максвелла определяется

формулой:

(20),

где mо

– масса молекулы, k

– постоянная Больцмана, Т – абсолютная

температура газа,

—

скорость молекулы.

Распределение

концентрации молекул газа в атмосфере

Земли (т.е.

в силовом поле) в зависимости от высоты

было дано австрийским физиком Больцманом

и называется

распределением

Больцмана:

(21)

Где n(h)

– концентрация молекул газа на высоте

h,

n0

– концентрация у поверхности Земли, g

– ускорение свободного падения, m

– масса молекулы.

Распределение

Больцмана.

Совокупность всех

значений случайной величины называется

простым

статистическим рядом.

Так как простой статистический ряд

оказывается большим, то его преобразуют

в вариационный

статистический

ряд или интервальный

статистический ряд. По интервальному

статистическому ряду для оценки вида

функции распределения вероятностей по

экспериментальным данным строят

гистограмму

– столбчатую

диаграмму. (Гистограмма – от греческих

слов “histos”–

столб и “gramma”–

запись).

n

-

h

Гистограмма

распределения Больцмана.

Для построения

гистограммы интервал, содержащий

полученные значения случайной величины

делят на несколько интервалов xi

одинаковой ширины. Для каждого интервала

подсчитывают число mi

значений случайной величины, попавших

в этот интервал. После этого вычисляют

плотность частоты случайной величины

для каждого интервала xi

и среднее значение случайной величины

<xi

> в каждом интервале.

Затем по оси абсцисс

откладывают интервалы xi,

являющиеся основаниями прямоугольников,

высота которых равна

(или

высотой

– плотностью относительной частоты

).

Расчетами показано,

что вероятность попадания нормально

распределенной случайной величины в

интервале значений от <x>–

до <x>+

в среднем равна 68%. В границах вдвое

более широких (<x>–2;

<x>+2)

размещается в среднем 95% всех значений

измерений, а в интервале (<x>–3;<x>+3)

– уже 99,7%. Таким образом, вероятность

того, что отклонение значений нормально

распределенной случайной величины

превысит 3

(

– среднее квадратичное отклонение)

чрезвычайно мала (~0,003). Такое событие

можно считать практически невозможным.

Поэтому границы <x>–3

и <x>+3

принимаются за границы практически

возможных значений нормально распределенной

случайной величины («правило трех

сигм»).

Если число измерений

(объем выборки) невелико (n<30),

дисперсия вычисляется по формуле:

(22)

Уточненное среднее

квадратичное отклонение отдельного

измерения вычисляется по формуле:

(23)

Напомним, что для

эмпирического распределения по выборке

аналогом математического ожидания

является среднее арифметическое значение

<x>

измеряемой величины.

Чтобы дать

представление о точности и надежности

оценки измеряемой величины, используют

понятия доверительного интервала и

доверительной вероятности.

Доверительным

интервалом

называется интервал (<x>–x,

<x>+x),

в который по определению попадает с

заданной вероятностью действительное

(истинное) значение измеряемой величины.

Доверительный интервал характеризует

точность полученного результата: чем

уже доверительный интервал, тем меньше

погрешность.

Доверительной

вероятностью

(надежностью)

результата серии измерений называется

вероятность того, что истинное значение

измеряемой величины попадает в данный

доверительный интервал (<x>±x).

Чем больше величина доверительного

интервала, т.е. чем больше x,

тем с большей надежностью величина <x>

попадает в этот интервал. Надежность

выбирается самим исследователем

самостоятельно, например, =0,95;

0,98. В медицинских и биологических

исследованиях, как правило, доверительную

вероятность (надежность) принимают

равной 0,95.

Если величина х

подчиняется нормальному закону

распределения Гаусса, а <x>

и <>

оцениваются по выборке (числу измерений)

и если объем выборки невелик (n<30),

то интервал (<x>

– t,n<>,

<x>

+ t,n<>)

будет доверительным интервалом для

известного параметра х с доверительной

вероятностью .

Коэффициент t,n

называется коэффициентом

Стьюдента

(этот коэффициент был предложен в 1908 г.

английским математиком и химиком В.С.

Госсетом, публиковавшим свои работы

под псевдонимом «Стьюдент» – студент).

Значении коэффициента

Стьюдента t,n

зависит от доверительной вероятности

и числа измерений n

(объема выборки). Некоторые значения

коэффициента Стьюдента приведены в

таблице 1.

Таблица 1

|

n |

|

||||||

|

0,6 |

0,7 |

0,8 |

0,9 |

0,95 |

0,98 |

0,99 |

|

|

2 |

1,38 |

2,0 |

3,1 |

6,3 |

12,7 |

31,8 |

63,7 |

|

3 |

1,06 |

1,3 |

1,9 |

2,9 |

4,3 |

7,0 |

9,9 |

|

4 |

0,98 |

1,3 |

1,6 |

2,4 |

3,2 |

4,5 |

5,8 |

|

5 |

0,94 |

1,2 |

1,5 |

2,1 |

2,8 |

3,7 |

4,6 |

|

6 |

0,92 |

1,2 |

1,5 |

2,0 |

2,6 |

3,4 |

4,0 |

|

7 |

0,90 |

1,1 |

1,4 |

1,9 |

2,4 |

3,1 |

3,7 |

|

8 |

0,90 |

1,1 |

1,4 |

1,9 |

2,4 |

3,0 |

3,5 |

|

9 |

0,90 |

1,1 |

1,4 |

1,9 |

2,3 |

2,9 |

3,4 |

|

10 |

0,88 |

1,1 |

1,4 |

1,9 |

2,3 |

2,8 |

3,3 |

В таблице 1 в верхней

строке заданы значения доверительной

вероятности

от 0,6 до 0,99, в левом столбце – значение

n.

Коэффициент Стьюдента следует искать

на пересечении соответствующих строки

и столбца.

Окончательный

результат измерений записывается в

виде:

(25)

Где

– полуширина доверительного интервала.

Результат серии

измерений оценивается относительной

погрешностью:

(26)

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

17 авг. 2022 г.

читать 1 мин

В статистике средняя абсолютная ошибка (MAE) — это способ измерения точности данной модели. Он рассчитывается как:

MAE = (1/n) * Σ|y i – x i |

куда:

- Σ: греческий символ, означающий «сумма».

- y i : Наблюдаемое значение для i -го наблюдения

- x i : Прогнозируемое значение для i -го наблюдения

- n: общее количество наблюдений

В следующем пошаговом примере показано, как рассчитать среднюю абсолютную ошибку в Excel.

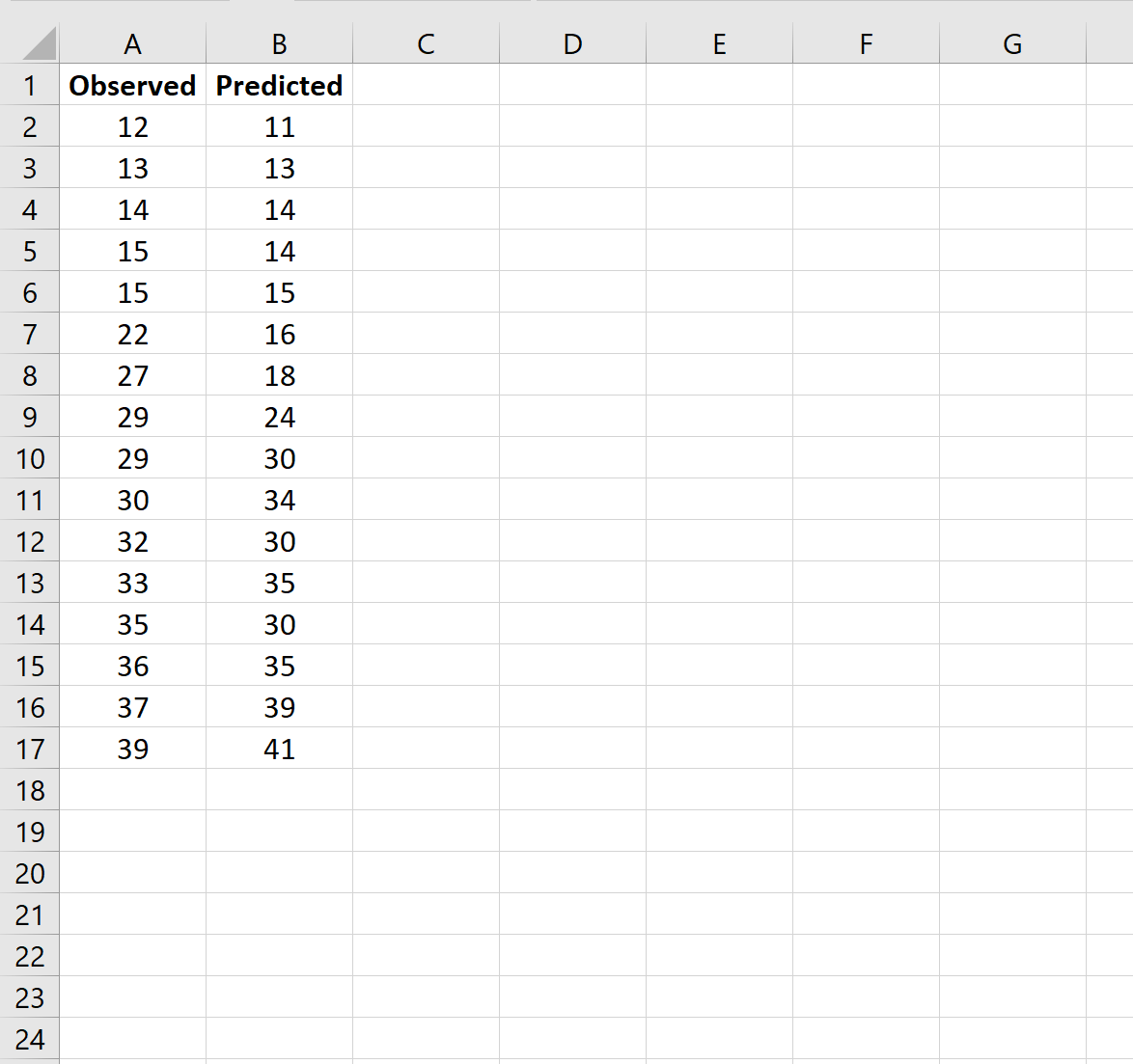

Шаг 1: введите данные

Во-первых, давайте введем список наблюдаемых и прогнозируемых значений в два отдельных столбца:

Примечание. Используйте это руководство , если вам нужно научиться использовать модель регрессии для расчета прогнозируемых значений.

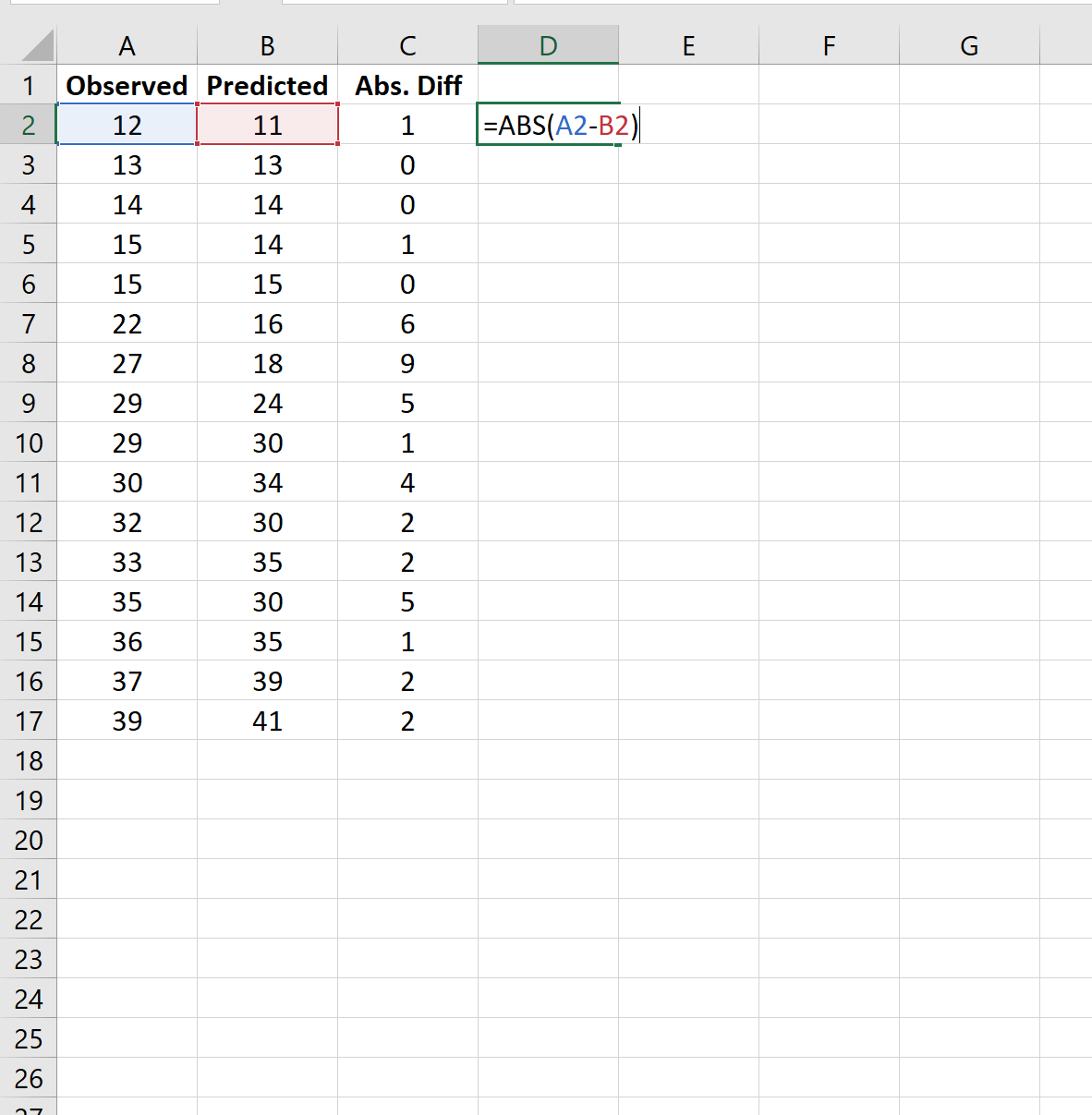

Шаг 2: Рассчитайте абсолютные разницы

Далее мы будем использовать следующую формулу для расчета абсолютных различий между наблюдаемыми и прогнозируемыми значениями:

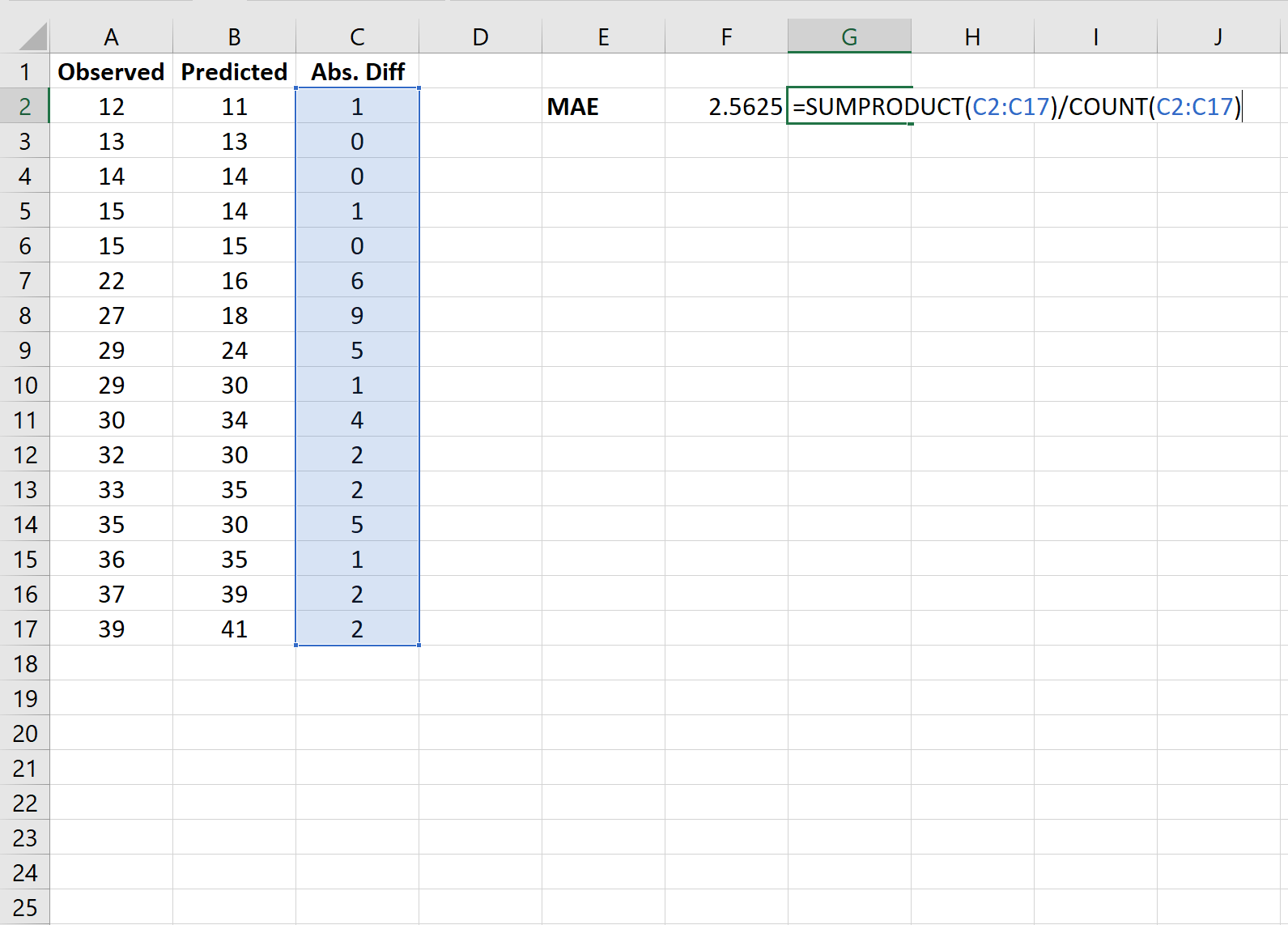

Шаг 3: Рассчитайте MAE

Далее мы будем использовать следующую формулу для расчета средней абсолютной ошибки:

Средняя абсолютная ошибка (MAE) оказывается равной 2,5625 .

Это говорит нам о том, что средняя абсолютная разница между наблюдаемыми значениями и предсказанными значениями составляет 2,5625.

Как правило, чем ниже значение MAE, тем лучше модель соответствует набору данных. При сравнении двух разных моделей мы можем сравнить MAE каждой модели, чтобы узнать, какая из них лучше подходит для набора данных.

Бонус: не стесняйтесь использовать этот Калькулятор средней абсолютной ошибки для автоматического расчета MAE для списка наблюдаемых и прогнозируемых значений.

Дополнительные ресурсы

Как рассчитать MAPE в Excel

Как рассчитать SMAPE в Excel

Написано

Замечательно! Вы успешно подписались.

Добро пожаловать обратно! Вы успешно вошли

Вы успешно подписались на кодкамп.

Срок действия вашей ссылки истек.

Ура! Проверьте свою электронную почту на наличие волшебной ссылки для входа.

Успех! Ваша платежная информация обновлена.

Ваша платежная информация не была обновлена.

Загрузить PDF

Загрузить PDF

Абсолютная ошибка – это разность между измеренным значением и фактическим значением.[1]

Эта ошибка характеризует точность измерений. Если вам известны фактическое и измеренное значения, можно с легкостью вычислить абсолютную ошибку. Но иногда фактическое значение не дано, поэтому в качестве абсолютной ошибки пользуются максимально возможной ошибкой.[2]

Если даны фактическое значение и относительная ошибка, можно вычислить абсолютную ошибку.

-

1

Запишите формулу для вычисления абсолютной ошибки. Формула:

, где

– абсолютная ошибка (разность между измеренным и фактическим значениями),

– измеренное значение,

– фактическое значение.[3]

-

2

Подставьте в формулу фактическое значение. Фактическое значение должно быть дано; в противном случае используйте принятое опорное значение. Фактическое значение подставьте вместо

.

- Например, нужно измерить длину футбольного поля. Фактическая длина (принятая опорная длина) футбольного поля равна 105 м (именно такое значение рекомендуется FIFA). Таким образом, фактическое значение равно 105 м:

.

- Например, нужно измерить длину футбольного поля. Фактическая длина (принятая опорная длина) футбольного поля равна 105 м (именно такое значение рекомендуется FIFA). Таким образом, фактическое значение равно 105 м:

-

3

Подставьте в формулу измеренное значение. Оно будет дано; в противном случае измерьте величину (длину или ширину и так далее). Измеренное значение подставьте вместо

.

- Например, вы измерили длину футбольного поля и получили значение 104 м. Таким образом, измеренное значение равно 104 м:

.

- Например, вы измерили длину футбольного поля и получили значение 104 м. Таким образом, измеренное значение равно 104 м:

-

4

Вычтите фактическое значение из измеренного значения. Так как абсолютная ошибка всегда положительна, возьмите абсолютное значение этой разницы, то есть не учитывайте знак «минус».[4]

Так вы вычислите абсолютную ошибку.- В нашем примере:

, то есть абсолютная ошибка измерения равна 1 м.

Реклама

- В нашем примере:

-

1

Запишите формулу для вычисления относительной ошибки. Формула:

, где

– относительная ошибка (отношение абсолютной ошибки к фактическому значению),

– измеренное значение,

– фактическое значение.[5]

-

2

Подставьте в формулу относительную ошибку. Скорее всего, она будет дана в виде десятичной дроби. Относительную ошибку подставьте вместо

.

- Например, если относительная ошибка равна 0,02, формула запишется так:

.

- Например, если относительная ошибка равна 0,02, формула запишется так:

-

3

Подставьте в формулу фактическое значение. Оно будет дано. Фактическое значение подставьте вместо

.

- Например, если фактическое значение равно 105 м, формула запишется так:

.

- Например, если фактическое значение равно 105 м, формула запишется так:

-

4

Умножьте обе стороны уравнения на фактическое значение. Так вы избавитесь от дроби.

-

5

Прибавьте фактическое значение к каждой стороне уравнения. Так вы найдете

, то есть измеренное значение.

-

6

Вычтите фактическое значение из измеренного значения. Так как абсолютная ошибка всегда положительна, возьмите абсолютное значение этой разницы, то есть не учитывайте знак «минус».[6]

Так вы вычислите абсолютную ошибку.- Например, если измеренное значение равно 107,1 м, а фактическое значение равно 105 м, вычисления запишутся так:

. Таким образом, абсолютная ошибка равна 2,1 м.

Реклама

- Например, если измеренное значение равно 107,1 м, а фактическое значение равно 105 м, вычисления запишутся так:

-

1

Определите единицу измерения. То есть выясните, было ли значение измерено с точностью до сантиметра, метра и так далее. Возможно, эта информация будет дана (например, «длина поля измерена с точностью до метра»). Чтобы определить единицу измерения, посмотрите на то, как округлено данное значение.[7]

- Например, если измеренная длина поля равна 106 м, значение было округлено до метров. Таким образом, единица измерения равна 1 м.

-

2

-

3

Используйте максимально возможную ошибку в качестве абсолютной ошибки.[9]

Так как абсолютная ошибка всегда положительна, возьмите абсолютное значение этой разницы, то есть не учитывайте знак «минус».[10]

Так вы вычислите абсолютную ошибку.- Например, если измеренная длина поля равна

м, то есть абсолютная ошибка равна 0,5 м.

Реклама

- Например, если измеренная длина поля равна

Советы

- Если фактическое значение не указано, найдите принятое опорное или теоретическое значение.

Реклама

Об этой статье

Эту страницу просматривали 25 667 раз.